Agenda

Durant els dies 19 i 20 d’abril tindrà lloc el III Fòrum Youth Act impulsat pel Servei Civil Internacional (SCI) i el Consell de la Joventut de Barcelona a Barcelona,...

11/04/2024

El passat 26 de març va tenir lloc, al Museu Comarcal Fundació Horta Sud a Torrent (Castelló), la Jornada “Banca Armada i finances ètiques: (des)inversió com a arma per una economia per la pau”. Durant la jornada vam tenir l’oportunitat d’escoltar les conferències de Carlos Taibo i Jordi Calvo al voltant del paper del militarisme, el negoci de la guerra...

Se condena y reprocha a Irán el ataque con drones y misiles a Israel, pero no se condena con la misma intensidad el ataque hace dos semanas al consulado de...

10/04/2024

Alacant, 10 d'abril del 2024. La campanya Banca Armada ha intervingut aquest matí en la Junta d'Accionistes del Banc Sabadell en representació d'accionistes crítics (amb un total de 84.749 accions) que prèviament havien delegat el seu vot. La intervenció en la Junta del Banc Sabadell ha estat l'última de les 4 juntes en què ha intervingut la campanya enguany, després...

14 abril, 2024, 9:00 pm

El cap de setmana del 13 i 14 d’abril, Coma-ruga acollirà el segon bloc de la 4a Escola Pacifista del Centre Delàs. L’edició de 2024 d’aquest cicle formatiu, sota el títol “Aturem el negoci de la guerra, repensem la seguretat”, tindrà lloc durant dos caps de setmana de març i abril a Barcelona i Coma-ruga i està adreçada a persones...

14/02/2024

El pressupost de Frontex s'ha multiplicat per vuit entre el 2012 i el 2022, passant de 89,58 milions a 754 milions d'euros. El pressupost per a les operacions de retorn de l'agència europea ha passat de 80.000 euros el 2005 a més de 69 milions el 2020. “Frontex no només augmenta en pressupost, també augmenta en efectius. Ha passat de...

23/01/2023

Podeu llegir la newsletter completa de desembre de 2022 aquí.

Ainhoa Ruiz Benedicto, Maria Fraile

08/02/2024

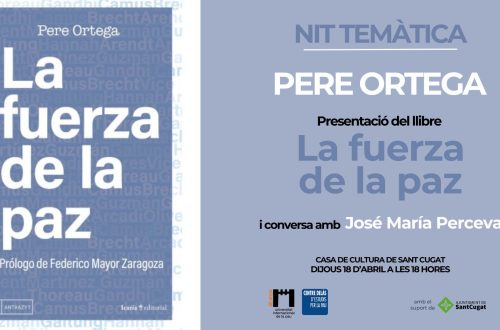

Xavier Bohigas, Pere Brunet, Blanca Camps-Febrer, Tica Font, Teresa de Fortuny, Tomàs Gisbert, José Luis Gordillo, Pere Ortega, Ainhoa Ruiz Benedicto

11/12/2023